Consideriamo un sistema isolato con due soli corpi di massa m1 ed m2 di cui si vuole calcolare le loro traiettorie: grazie agli studi di Keplero sappiamo che il problema ha una soluzione unica. I loro moti appartengono alla famiglia delle coniche: iperbole o parabola se le traiettorie sono aperte, ellissi per traiettorie chiuse.

Il mondo reale è ben diverso, ci sono molti corpi che interagiscono e le equazioni di Keplero non si possono usare; supponendo anche solo di dover pianificare una missione dalla Terra alla Luna dobbiamo considerare tre oggetti: la Terra, la Luna e il nostro modulo spaziale1 di massa m3. Se consideriamo invece i viaggi interplanetari, come per esempio quello delle Voyager, il problema è ancora più complicato: come calcolare la traiettoria di m3?

La soluzione è suddividere la traiettoria in più segmenti di volo ognuno dei quali è costituito da due corpi ed un terzo corpo che disturba i primi due. Lo scopo è stabilire in che parte della traiettoria quale dei due corpi m1 o m2 influenza in maniera dominante la traiettoria del terzo corpo m3 e quale può essere considerata un disturbo gravitazionale. Si introduce quindi il concetto di sfera d’influenza (SOI) nota anche come sfera di Laplace: un modello matematico usato per la pianificazione della traiettorie di sonde spaziali. Ho notato che in letteratura c’è molta confusione al riguardo, con diverse definizioni spesso fuorvianti: per esempio ci sono fonti dove riportano come SOI la regione in cui l’effetto gravitazionale di m1 su m3 termina e rimane solo l’effetto gravitazionale di m2. Questa definizione è errata in quanto la gravità è una forza sempre presente.

La SOI si basa su due componenti di forze: l’azione gravitazionale di corpo principale ed un’azione di disturbo che agiscono su un terzo corpo in moto all’interno dello spazio gravitazionale dei primi due.

Sia un sistema di tre corpi Terra-Luna-CSM di massa mT, mL ed mC rispettivamente in un sistema di riferimento inerziale rispetto alla Terra. Sia inoltre rTC il vettore Terra-CSM, rLC il vettore Luna-CSM ed rTL il vettore Terra-Luna. Calcoliamo l’effetto del sistema Terra-CSM con la perturbazione della Luna rispetto ad un sistema di riferimento inerziale terrestre.

Procediamo con l’impostazione del sistema di due equazioni: nella prima esprimiamo con il contributo principale della Terra sul CSM, mentre con la seconda equazione

consideriamo due contributi: quello che la Luna esercita sul CSM (primo termine) e quello perturbativo della Luna sugli altri due corpi:

\begin{dcases}

\overrightarrow{F}_{principale, T} = G \frac {(m_{T} + m_{C})} { {\lVert \overrightarrow{r_{TC}} \rVert}^{3} } \overrightarrow{r_{TC}}\\

\overrightarrow{F}_{perturbazione, T} = - G m_{L} \left[ \frac{\overrightarrow{r_{LC}}} {{\lVert \overrightarrow{r_{LC}} \rVert}^{3}} + \frac{\overrightarrow{r_{TL}}} {{\lVert \overrightarrow{r_{TL}} \rVert}^{3}} \right]

\end{dcases}Stesso ragionamento per il sistema di riferimento selenocentrico per il sistema Luna-CSM con la perturbazione gravitazionale della Terra. Consideriamo l’azione principale della Luna sul CSM mentre con la seconda equazione

consideriamo due contributi: quello che la Terra esercita sul CSM (primo termine) e quello perturbativo della Terra sugli altri due corpi (secondo termine):

\begin{dcases}

\overrightarrow{F}_{principale, L} = \frac {G (m_{L} + m_{C})} { {\lVert \overrightarrow{r_{LC}} \rVert}^{3} } \overrightarrow{r_{LC}}\\

\overrightarrow{F}_{perturbazione, L} = - G m_{T} \left[ \frac{\overrightarrow{r_{TC}}} {{\lVert \overrightarrow{r_{TC}} \rVert}^{3}} + \frac{\overrightarrow{r_{TL}}} {{\lVert \overrightarrow{r_{TL}} \rVert}^{3}} \right]

\end{dcases}

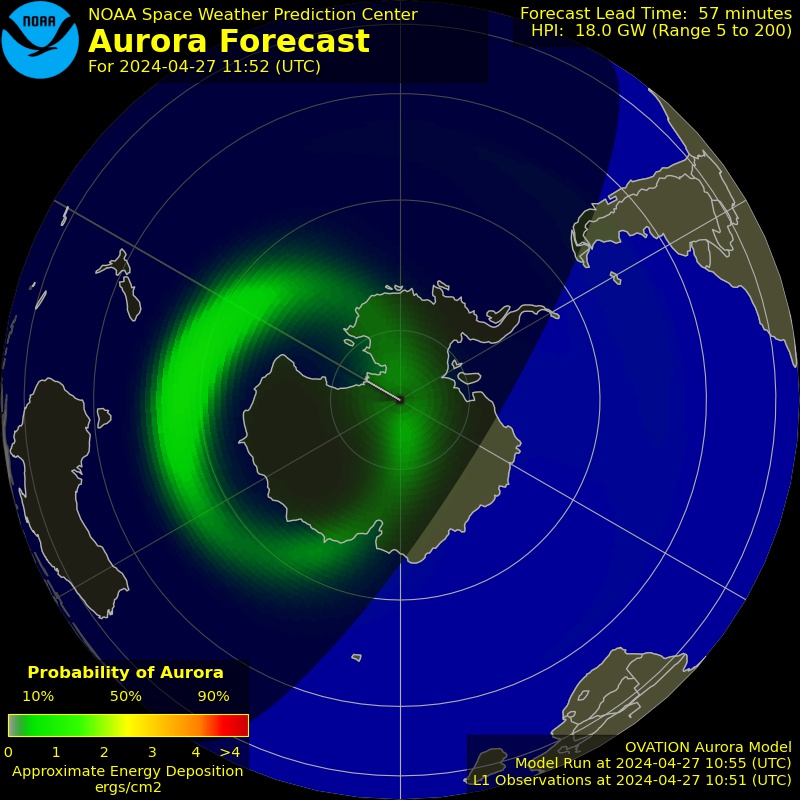

Il corpo mC si trova in SOI terrestre.

In colore si è cercato di esprimere le “azioni gravitazionali” mentre il tratto corsivo indica i vettori di distanza.

Disegno di Giorgia Rizzi

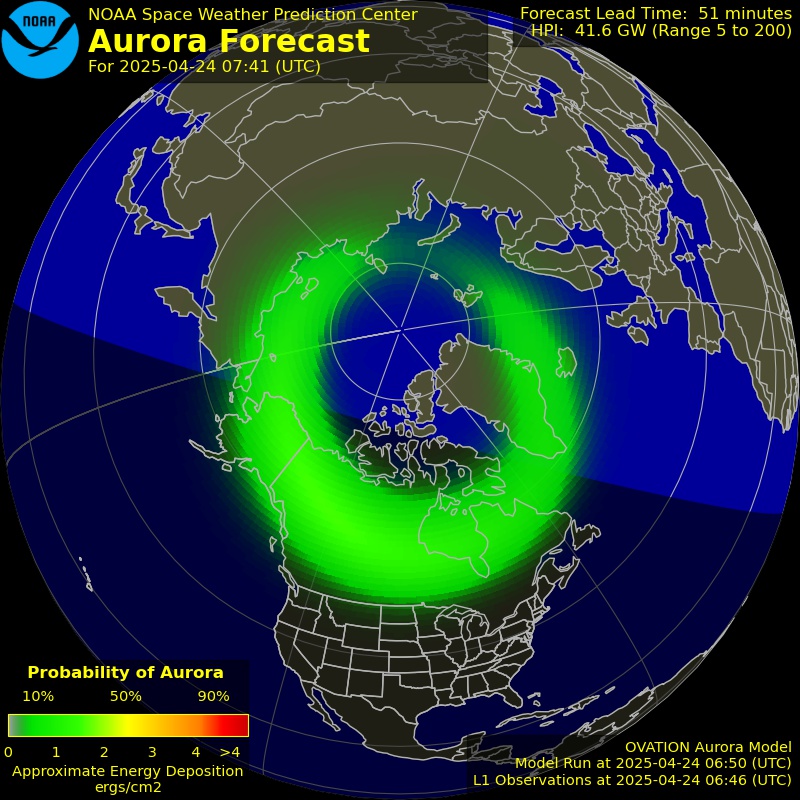

Il corpo mC si trova in SOI lunare.

In colore si è cercato di esprimere le “azioni gravitazionali” mentre il tratto corsivo indica i vettori di distanza.

Disegno di Giorgia Rizzi

Siano dati tre corpi mT, mL ed mC ( e

). Un corpo celeste mC si trova nella sfera di influenza del corpo 1 di massa mT rispetto ad un secondo corpo celeste 2 di massa mL se:

\begin{equation}

\textcolor{red}{\frac{\overrightarrow{F}_{perturbazione, T}}{\overrightarrow{F}_{principale, T}} < \frac{\overrightarrow{F}_{perturbazione, L}}{\overrightarrow{F}_{principale, L}}}

\end{equation}

Ovvero mC si trova in SOI del corpo mT se il rapporto tra il disturbo gravitazionale subìto da mT e l’azione gravitazionale principale esercitata da mT è minore rispetto al rapporto tra il disturbo gravitazionale subìto da mL e l’azione gravitazionale principale esercitata da mL.

Non esiste ovviamente nulla di fisico che separa la due regioni, né si avverte alcun cambiamento di forza all’interno del corpo mC: questo concetto era ben noto anche agli astronauti delle missioni Apollo in viaggio per la Luna.

Nel programma Apollo il passaggio in SOI lunare segnava l’istante di tempo in cui avveniva il cambiamento del sistema di riferimento di coordinate BRCS (Basic Reference Coordinate System) usato a terra al MCC (Mission Control Center) da terrestre a lunare. Questo cambiamento procurava apprensione ai visitatori e giornalisti presenti nella piccola tribuna situata dietro ai banchi (trenches) della Sala di Controllo a Houston perché i vettori di stato p e v del CSM cambiavano improvvisamente valore dando l’impressione ai non addetti ai lavori che fosse successo qualcosa di pericoloso a bordo.

La geometria della regione della SOI in realtà non è una sfera ma piuttosto uno sferoide in quanto, essendo un calcolo vettoriale, dipende dalla direzione di arrivo di mC. A seconda delle semplificazioni che si vogliono introdurre, esistono delle formule che forniscono un valore approssimato del raggio di SOI RSOI. La formula qui sotto fornisce ad esempio il valore di RSOI per un pianeta di massa mL rispetto ad un pianeta di massa mT. La variabile rappresenta la distanza fra i due corpi mT ed mL: nel nostro caso la distanza media Terra-Luna.

R_{SOI} \simeq d \left( \frac{m_{L}}{m_{T}} \right)^{\frac{2}{5}}

Il raggio della SOI lunare è più grande del raggio della sfera di Hill. Grafico dell’autore.

Sostituendo le costanti note della Terra e della Luna si ottiene un valore approssimativo di RSOI in linea con quanto riportato nell’Apollo Flight Journal 13 al GET (Ground Elapsed Time) 059:01:53.

- RSOI della Luna: 66193,29 km (35741,53 nmi), ovvero un valore che comprende la sua sfera di Hill.

- RSOI della Terra: 924402,75 km (499137,74 nmi), ovvero un valore che comprende l’orbita lunare.

All’interno del Sistema Solare il pianeta con la sfera di influenza più grande non è Giove ( km) bensì Nettuno (

km): questo perché la sua maggiore distanza dal Sole compensa pienamente il fatto di avere una massa più piccola rispetto al gigante del Sistema Solare nonostante quest’ultimo risenta maggiormente dell’effetto gravitazionale del Sole.

Nota: per la presente discussione si e fatto riferimento ai lavori di John D. Cook e di Matthew Peet citati in bibliografia.

Bibliografia

- Apollo 13 Flight Journal, NASA

- Spacecraft Dynamics and Control, Matthew M. Peet – Arizona State University. Interplanetary Mission Planning.

- Sphere of Influence John d. Cook.

Note

- Come ad esempio il CSM del programma Apollo in viaggio per la Luna. ↩︎